A/B Testing: exemples et bonnes pratiques

8min • Édité le 20 avr. 2026

Alexandra Augusti

Chief of Staff

Avant d'optimiser une stratégie marketing, une question centrale se pose : quelle version d'un contenu, d'un design ou d'un parcours utilisateur génère réellement le plus de conversions ?

Dans un environnement digital où chaque interaction est mesurable, il devient essentiel de s'appuyer sur des données fiables pour orienter ses décisions.

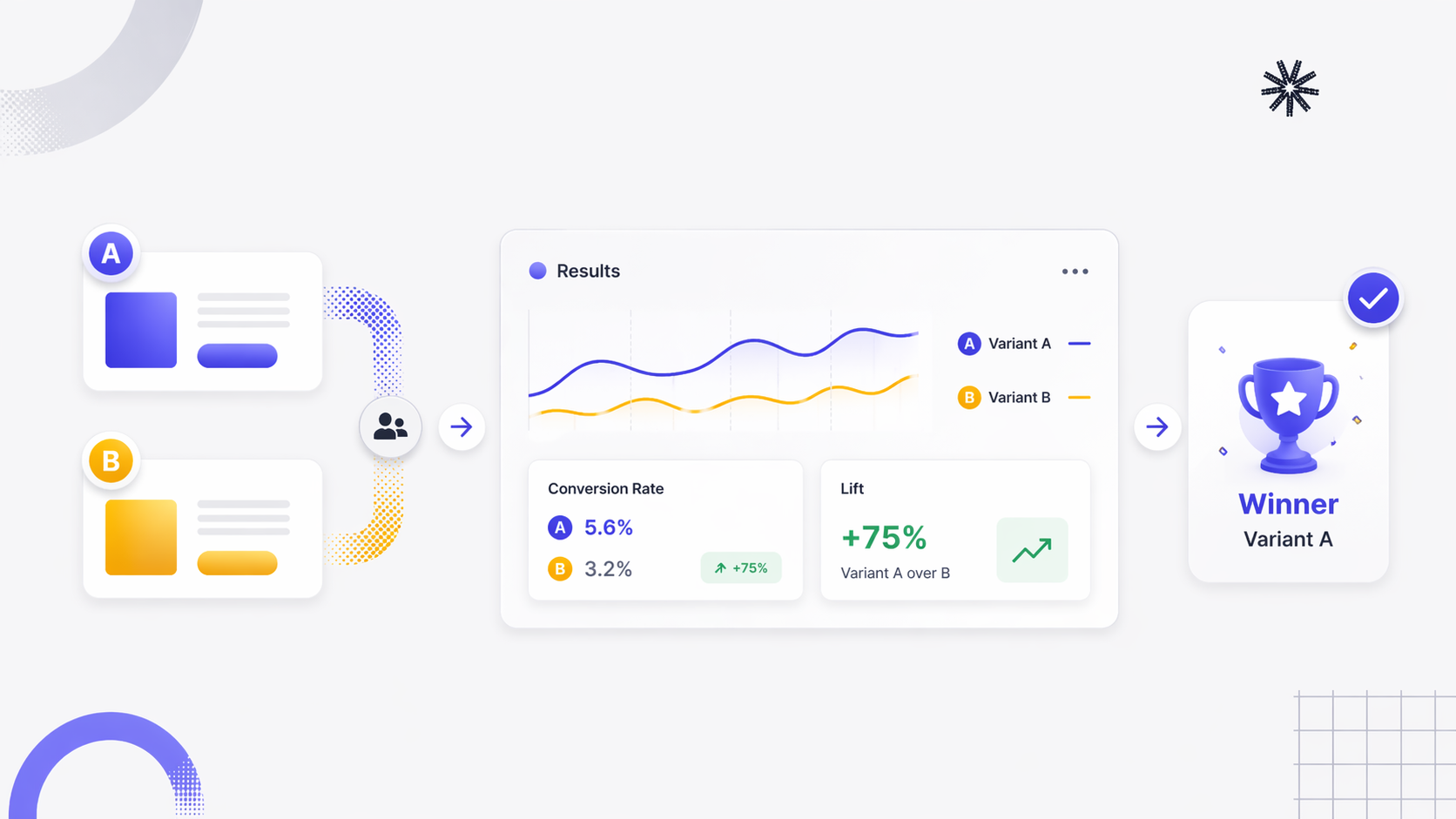

C'est dans ce contexte que s'impose l'A/B testing, une méthode d'expérimentation qui permet de comparer différentes variantes d'un même élément afin d'identifier celle qui maximise un objectif donné.

Utilisé en marketing digital, en UX, en CRO (Conversion Rate Optimization) et en product management, l'A/B testing permet de passer d'une logique d'intuition à une logique d'optimisation continue basée sur la donnée.

Les informations à retenir

L'A/B testing repose sur la comparaison de deux variantes (A et B) d'un même élément : page, email, CTA, design, contenu.

Il s'agit d'une expérimentation contrôlée basée sur une répartition aléatoire du trafic entre les différentes versions.

Il permet d'optimiser des KPI clés : taux de conversion, taux de clic, engagement, revenu par visiteur.

Sa fiabilité dépend d'une analyse statistique rigoureuse, d'hypothèses bien formulées et d'un volume de données suffisant.

Qu'est-ce que l'A/B testing ?

L'A/B testing, aussi appelé split testing, est une méthode d'optimisation qui consiste à tester différentes versions d'un même élément afin d'en mesurer l'impact sur le comportement des utilisateurs.

Concrètement, deux variantes sont mises en place :

une version A, qui correspond à la version actuelle (contrôle) ;

une version B, qui intègre une modification spécifique.

Les visiteurs sont ensuite répartis de manière aléatoire entre ces deux versions. Cette répartition permet d'isoler l'effet d'un changement précis et d'en mesurer l'impact réel sur les performances.

L'objectif est de répondre à une question simple : quelle variation génère le meilleur résultat ?

Mais derrière cette simplicité apparente, l'A/B testing s'inscrit dans une logique beaucoup plus structurée. Il permet de valider des hypothèses, d'optimiser des parcours clients et d'améliorer la performance marketing à chaque étape du funnel.

Il s'agit donc d'un véritable outil d'expérimentation et d'aide à la décision.

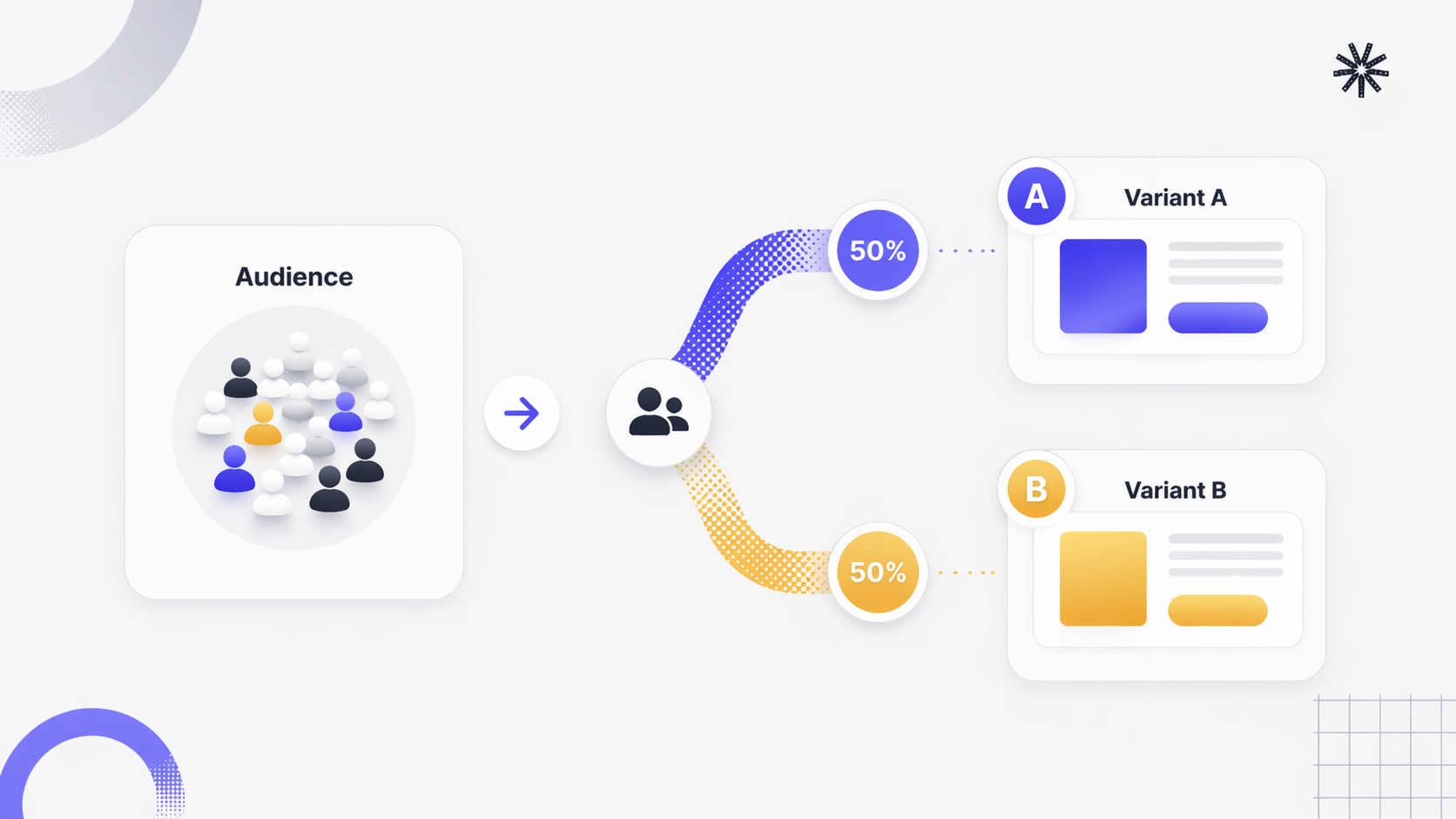

Principe de l'AB Testing

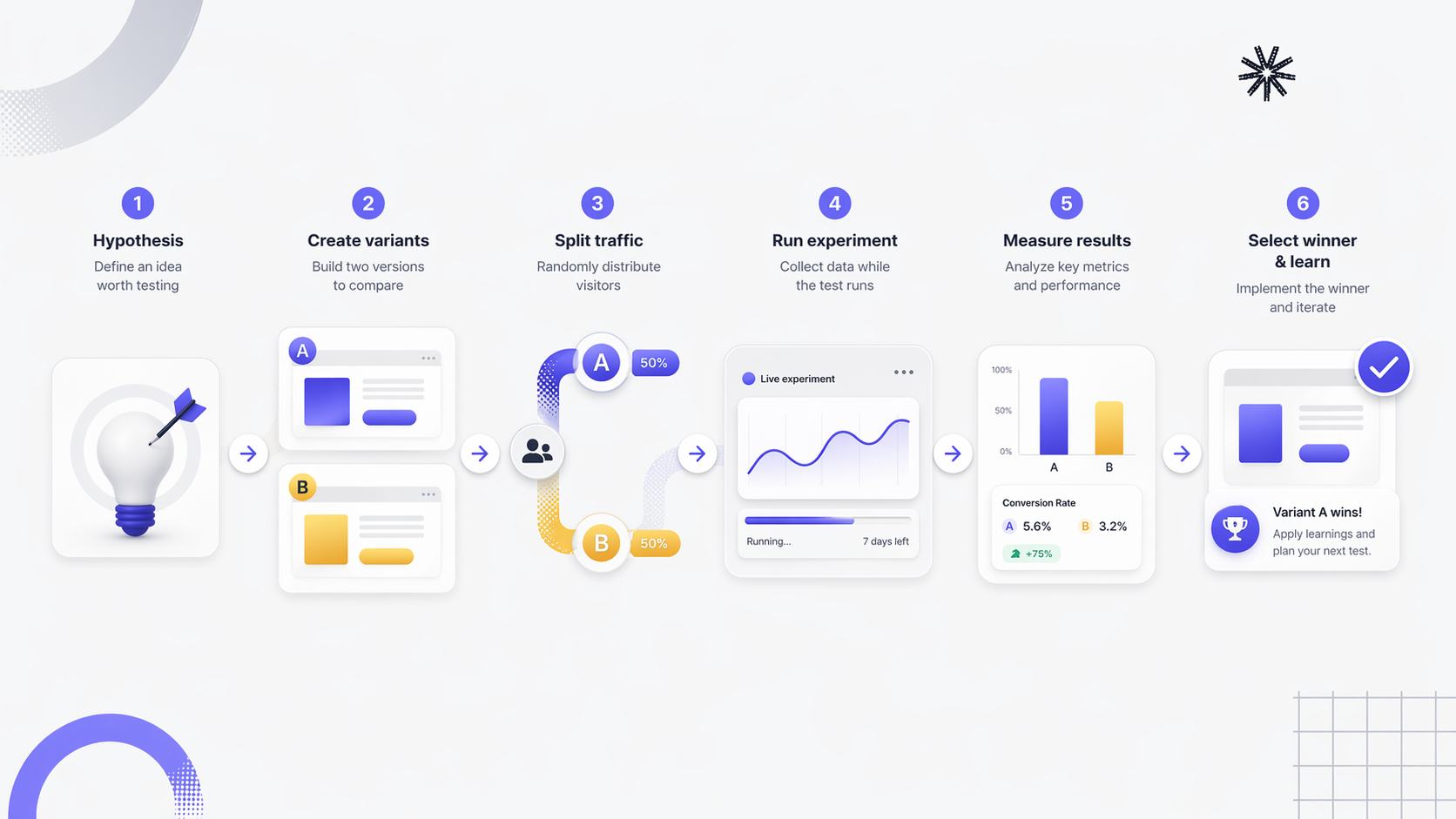

Comment fonctionne un A/B test ? Les étapes clés

Un A/B test repose sur une démarche méthodologique proche de l'expérimentation scientifique. Chaque étape est essentielle pour garantir la fiabilité des résultats et éviter les biais.

1. Formuler des hypothèses claires

Tout test commence par des hypothèses précises, directement liées à un objectif de performance.

Par exemple : "Modifier le texte du call-to-action sur notre page de téléchargement augmentera le taux de conversion de 10 %."

Une hypothèse efficace doit être mesurable, actionnable et orientée business. Sans cette étape, les résultats du test ne peuvent pas être correctement interprétés.

2. Créer les variantes

Deux versions sont ensuite mises en place. La version A correspond à la référence, tandis que la version B introduit une modification ciblée.

Les éléments testés peuvent être très différents :

titre ou proposition de valeur sur une landing page ;

visuel ou design d'une bannière publicitaire ;

CTA (couleur, texte, emplacement) ;

structure d'une page ou d'un formulaire ;

objet d'un email ou contenu d'un emailing ;

prix ou offre promotionnelle.

La règle clé reste la même : tester une seule variable à la fois afin d'isoler son impact et éviter toute confusion dans l'analyse.

3. Répartir le trafic entre les versions

Le trafic est ensuite réparti aléatoirement entre les différentes variantes. Une répartition classique est de 50 % des visiteurs vers la version A et 50 % vers la version B.

Cette randomisation garantit la validité du test et assure une comparaison fiable entre les variantes, indépendamment de facteurs externes comme le device utilisé ou la source du trafic.

4. Mesurer les performances et analyser les données

Une fois le test lancé, les performances sont analysées à partir de plusieurs indicateurs :

taux de conversion ;

taux de clic (CTR) ;

revenu par visiteur ou par utilisateur ;

engagement et temps passé sur la page ;

taux de rebond.

Mais une analyse pertinente ne s'arrête pas à ces métriques. Elle doit intégrer une dimension statistique pour vérifier la significativité des résultats. Sans ce contrôle, un test ne peut pas être considéré comme fiable.

AB Testing étape par étape

Exemples concrets d'A/B testing en marketing

L'A/B testing s'applique à l'ensemble des leviers marketing et produits. Voici quelques exemples parlants pour illustrer la fonction de cette méthode dans différents contextes.

Sur une landing page, une entreprise peut tester deux propositions de valeur différentes dans le titre principal. Un simple changement de wording peut modifier la perception du visiteur et augmenter significativement le taux de conversion.

En e-commerce, tester la couleur ou le texte d'un bouton d'achat influence directement le comportement d'achat. Des modifications apparemment mineures — "Ajouter au panier" vs "Commander maintenant" — peuvent réduire les frictions et améliorer les performances.

En emailing, le test de lignes d'objet est l'un des leviers les plus rapides pour optimiser le taux d'ouverture. Tester une formulation personnalisée face à une formulation générique permet d'identifier les messages les plus engageants pour votre audience.

En publicité digitale, les sites comme Facebook Ads ou Google Ads permettent de tester différentes versions d'une même annonce — visuels, accroches, CTA — afin d'optimiser le ROAS sur chaque campagne.

Ces exemples montrent que l'optimisation passe souvent par des micro-variations à fort impact.

Pourquoi utiliser l'A/B testing ?

L'A/B testing répond à un enjeu majeur : prendre des décisions basées sur des données concrètes plutôt que sur des intuitions ou des opinions internes.

Dans de nombreuses organisations, les choix marketing reposent encore sur des perceptions subjectives. Cette approche limite les performances et introduit des biais difficiles à corriger.

L'A/B testing permet au contraire de :

valider objectivement une hypothèse avant de la déployer à grande échelle ;

réduire le risque décisionnel en s'appuyant sur des résultats mesurables ;

améliorer progressivement les performances à chaque itération ;

mieux comprendre les comportements des utilisateurs et leurs attentes réelles ;

optimiser le budget marketing en investissant dans ce qui fonctionne réellement.

Même une amélioration marginale peut générer un impact significatif. Sur des volumes importants de visiteurs, une hausse du taux de conversion se traduit directement par une augmentation du chiffre d'affaires.

C'est cette logique d'optimisation incrémentale qui fait la puissance de l'A/B testing.

Comment mettre en place un A/B test efficace ?

Mettre en place un A/B test efficace nécessite une approche structurée. Il ne s'agit pas simplement de tester au hasard, mais de construire une véritable stratégie d'expérimentation.

La première étape consiste à définir un objectif clair. Chaque test doit être lié à un KPI précis : taux de conversion, taux d'ouverture d'un emailing, revenu moyen par visiteur, etc.

Ensuite, il est essentiel de prioriser les tests en fonction de leur impact potentiel. Les zones à fort trafic ou les étapes critiques du funnel doivent être traitées en priorité :

pages avec un volume de visiteurs élevé ;

pages avec un faible taux de conversion ;

étapes clés du tunnel d'achat ou d'inscription.

Le volume de données joue également un rôle central. Un test doit durer suffisamment longtemps pour atteindre une significativité statistique. Un test trop court peut produire des résultats trompeurs — c'est l'une des erreurs les plus fréquentes.

Enfin, les outils d'A/B testing permettent de structurer l'expérimentation. Des solutions comme Optimizely, AB Tasty ou VWO offrent des fonctionnalités avancées pour gérer les différentes versions et analyser les performances.

Comment analyser les résultats ?

L'analyse des résultats est une étape critique dans toute démarche d'A/B testing.

Un résultat ne peut être exploité que s'il atteint un seuil de significativité statistique. Sans ce critère, il est impossible de distinguer un effet réel d'une simple variation aléatoire.

Mais au-delà de la statistique, l'analyse doit être globale. Se concentrer uniquement sur un seul KPI peut conduire à des conclusions biaisées. Il est recommandé d'analyser :

la performance globale sur le KPI principal ;

les effets secondaires (panier moyen, taux de rétention, engagement) ;

la qualité du trafic généré ;

le comportement post-conversion des utilisateurs.

Une analyse avancée implique également de segmenter les résultats. Une variation peut performer très différemment selon :

le device utilisé (mobile vs desktop) ;

la source de trafic (organique, paid, emailing) ;

le profil de l'utilisateur (nouveau visiteur vs client existant).

C'est cette lecture approfondie qui permet de transformer un test en levier business durable.

Résultats de l'AB Testing

Bonnes pratiques pour réussir ses A/B tests

Pour maximiser l'efficacité des tests et éviter les biais les plus courants, quelques bonnes pratiques doivent être respectées.

Tester en continu dans une logique d'optimisation et non de manière ponctuelle.

Documenter chaque expérimentation : hypothèses, versions testées, résultats et enseignements.

Tester une seule variable à la fois pour isoler correctement l'impact de chaque modification.

Ne pas arrêter un test trop tôt : attendre la significativité statistique avant de tirer des conclusions.

Prioriser les tests à fort impact sur les pages et étapes les plus stratégiques du funnel.

L'A/B testing doit être intégré dans une culture de l'expérimentation et de la performance, partagée par les équipes marketing, produit et data.

Limites de l'A/B testing

Malgré ses avantages, l'A/B testing présente certaines limites à connaître.

Il nécessite un volume de visiteurs suffisant pour produire des résultats fiables. Les sites à faible trafic auront du mal à obtenir des résultats statistiquement significatifs dans un délai raisonnable.

Les résultats peuvent également être influencés par des facteurs externes difficiles à contrôler : saisonnalité, campagnes publicitaires en cours, actualité du secteur.

Enfin, l'A/B testing optimise des éléments spécifiques sans nécessairement remettre en question la stratégie globale. Il doit donc être intégré dans une vision plus large de l'optimisation marketing, en lien avec les objectifs business de l'entreprise.

A/B testing et stratégie data-driven

L'A/B testing prend toute sa dimension lorsqu'il est connecté à une stratégie data-driven et à une connaissance fine des audiences.

Plutôt que de tester de manière uniforme sur l'ensemble des visiteurs, les entreprises peuvent segmenter leurs audiences et adapter les expériences en fonction des profils utilisateurs :

nouveaux visiteurs vs clients existants ;

utilisateurs mobile vs desktop ;

clients à forte valeur (LTV élevée) vs clients occasionnels ;

audiences acquises via emailing vs publicité payante.

Cette approche permet d'aller au-delà d'un simple test global et d'optimiser chaque segment de manière spécifique, pour des résultats bien plus précis et actionnables.

Dans ce contexte, une Customer Data Platform (CDP) composable comme DinMo permet d'unifier les données clients issues de différentes sources, de créer des segments dynamiques et de mesurer l'impact réel des optimisations sur les conversions et le chiffre d'affaires.

L'A/B testing devient alors un outil stratégique de pilotage de la performance marketing — au service d'une personnalisation à grande échelle.

Conclusion

L'A/B testing est aujourd'hui un levier incontournable pour améliorer la performance marketing. En testant différentes variantes — pages, emails, CTA, design, contenu — les entreprises peuvent identifier ce qui fonctionne réellement et optimiser leurs actions de manière continue.

Mais sa véritable puissance réside dans son intégration au sein d'une stratégie globale basée sur la donnée et une bonne connaissance des audiences.

L'objectif n'est pas seulement de tester. C'est de comprendre, d'analyser et d'optimiser durablement.

👉 Découvrez comment DinMo vous aide à exploiter vos données clients pour améliorer vos performances marketing et votre Customer Lifetime Value (LTV). 🚀

FAQ

1. Quelle taille d'échantillon est nécessaire pour qu'un A/B test soit fiable ?

La fiabilité d'un A/B test dépend du volume de visiteurs exposés aux différentes variantes. Plus l'échantillon est grand, plus les résultats sont statistiquement fiables. La taille nécessaire varie selon le taux de conversion initial et l'amélioration attendue. En pratique, les équipes marketing utilisent des calculateurs statistiques pour déterminer le nombre minimum de visiteurs requis avant de lancer un test.

2. Peut-on tester plusieurs variantes en même temps ?

Oui, mais il ne s'agit plus strictement d'un A/B test. Lorsque plusieurs versions sont testées simultanément (A/B/C/D…), on parle de test A/B/n. Cette méthode permet de comparer plusieurs hypothèses en parallèle, mais elle nécessite un volume de trafic plus important pour conserver des résultats significatifs pour chaque variante.

3. Quelle est la différence entre A/B testing et personnalisation ?

L'A/B testing consiste à comparer différentes variantes pour identifier celle qui performe le mieux auprès de l'ensemble des visiteurs. La personnalisation, elle, adapte l'expérience en fonction du profil ou du comportement d'un utilisateur spécifique. Les deux approches sont complémentaires : les tests permettent d'identifier les meilleures variantes, qui peuvent ensuite être déployées de manière personnalisée selon les segments d'audience.

4. Combien de temps doit durer un A/B test ?

Un A/B test doit durer au minimum une à deux semaines pour couvrir les variations naturelles du comportement des utilisateurs (notamment les effets de saisonnalité hebdomadaire). L'arrêt du test doit être conditionné à l'atteinte de la significativité statistique, et non à une durée fixe. Arrêter un test trop tôt est l'une des erreurs les plus fréquentes et les plus coûteuses en termes de fiabilité des résultats.